Videotechnologie: Videostandard H.264 hat Branche vorangetrieben

Videotechnologie: Videostandard H.264 hat Branche vorangetrieben. Der nachfolgende Artikel setzt eine Reihe von Beiträgen des ZVEI-Fachverbands Sicherheitssysteme, Fachkreis Videos...

Videotechnologie: Videostandard H.264 hat Branche vorangetrieben. Der nachfolgende Artikel setzt eine Reihe von Beiträgen des ZVEI-Fachverbands Sicherheitssysteme, Fachkreis Videosysteme, zum Thema Veränderungen in der modernen Videotechnik (Einfluss von IP- und Digitaltechnik, die Bedeutung der Bildanalyse und der Detektionsalgorithmen) fort. Nachfolgend schildert Dr. Frank Bauernöppel (DResearch Digital Media Systems GmbH), Fachkreis Videosysteme, die Entwicklungen im Bereich Videokodierung.

Grundbausteine der Videokodierung

Aus dem Jahr 1929 datiert eine Patentanmeldung, die ein Verfahren zur Verbesserung von (damals analogen) Videoübertragungen beschreibt: Man übertrage anstelle einer Folge von Einzelbildern (Abb. 1) immer nur die Änderungen in der Szene in Form von Differenzbildern (Abb. 2). Das man dadurch in der Regel eine Einsparung erzielt liegt daran, dass eine Videoszene nicht eine Aneinanderreihung zusammenhangloser Einzelbilder ist, sondern sich zeitlich benachbarte Bilder einander ähnlich sind (zeitliche Korrelation von Videodaten).

Zeitlich benachbarte Bilder werden sich noch viel ähnlicher (und damit das Einsparungspotential viel größer), wenn man bewegte Objekte verfolgt (Abb. 3) und anstelle der Objekte selbst nur deren Bewegungsinformation überträgt, z.B. Form einfacher Verschiebungsvektoren ("Bewegungsvektoren"). Dies setzt jedoch eine digitale Repräsentation der Bilder und genügend CPU Performance voraus und wurde seit den 70er Jahren erforscht.

Eine andere einfache Beobachtung ist, dass innerhalb eines einzelnen Bildes benachbarte Bildpunkte oft ähnlich sind, etwa der blaue Himmel im Hintergrund einer Landschaftsaufnahme. Man spricht hier von einer örtlichen Korrelation von Bild- oder Videodaten. Auch dies lässt sich für eine effektivere Kodierung von digitalen Bildern oder Video ausnutzen, indem man die Daten einer mathematischen Transformation unterzieht, etwa bei JPEG und den verschiedenen MPEG Verfahren einer Digitalen Kosinus Transformation (DCT) und anschließend geschickt rundet (Quantisierung).

Beim Runden nutzt man auch die Eigenschaft des menschlichen Sehens aus, für verschiedene Strukturen (Ortsfrequenzen) verschieden empfindlich zu sein. Außerdem ist die Quantisierung die wichtigste Stellschraube zum Einstellen einer gewünschten Dateigröße oder Bitrate. Bewegungsvektoren und transformierte und quantisierte (Rest-)Bilddaten machen den Hauptteil digitaler kodierter Videodaten aus.

Bevor diese aber gespeichert oder versendet werden, entfernt man in einem letzten Schritt, der Entropiekodierung (nach Shannon 1946), noch letzte Redundanzen aus den Videodaten. Dieser Schritt ist vergleichbar mit dem Einzippen von Textdateien, die ja aufgrund der unterschiedlichen Buchstaben Häufigkeiten und Wiederholungen auch ohne Informationsverlust komprimiert werden können.

MPEG, H.26x und Variationen zum Thema

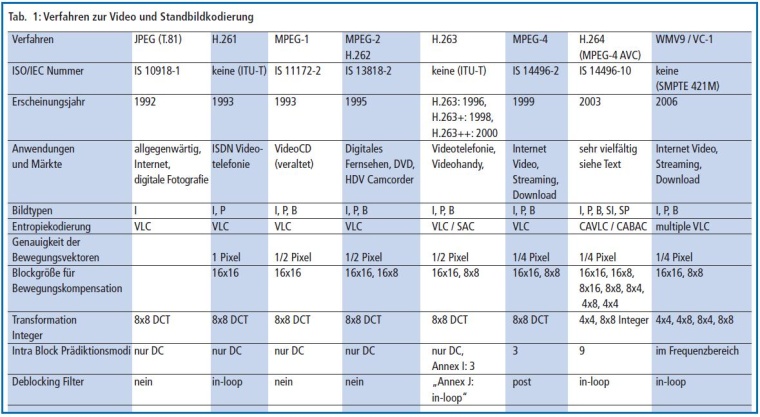

Basierend auf den obigen Grundlagen hat sich vor allem in den letzten zwei Jahrzehnten ein großes Betätigungsfeld für die Forschung und Entwicklung von Videokodierungsverfahren aufgetan. Angeregt durch die immer höhere CPU Performance hat man die Basisverfahren immer weiter verfeinert und neue, komplexere Algorithmen hinzugefügt, die noch besser komprimieren als ihre Vorgänger. Bspw. hat man die Genauigkeit der Bewegungsvektoren immer weiter erhöht und erlaubt Bildvorhersagen von mehreren Bildern (B-Bilder). Bei der Entropiekodierung haben die rechenaufwändigen arithmetischen Kodierverfahren (SAC, CABAC) die relativ einfachen VLC Huffman Codes überholt.

Eine Vorreiterrolle der technologischen Entwicklung hat dabei die MPEG Arbeitsgruppe (Moving Picture Experts Group) der ISO eingenommen, die 1988 von Leonardo Chiariglione nach dem Vorbild der JPEG Arbeitsgruppe gegründet wurde und seitdem eine Reihe bedeutender Standards wie MPEG-1, MPEG-2 und MPEG-4 hervorgebracht hat. Weitere wichtige Impulse kamen aus der Telekommunikation (damals CCITT, heute ITU-T) mit ersten Empfehlungen zur Videotelefonie (H.26x) in den 90er Jahren.

Wie komplex Videokodierung geworden ist, zeigt auf beeindruckende Weise die Anzahl der Textseiten, auf denen die Standards niedergeschrieben werden: 1993 genügten 25 Seiten für die Definition von H.261, 10 Jahre später benötigt die erste Ausgabe von H.264 269 Seiten, die Fassung von 2005 hat inzwischen 330 Seiten.

Dabei konzentrieren sich die Standards lediglich auf die Syntax und Semantik der kodierten Bitströme. Sie stellen eine Reihe von Werkzeugen wie Bewegungskompensation, Vorhersage von Bildblöcken, aus anderen Bildern, Transformationskodierung usw. zur Verfügung und definieren, wie man aus einem kodierten Bitstrom durch Anwendung dieser Werkzeuge das Video dekodiert. Die Kodierung selbst ist nicht standardisiert, jeder Hersteller kann und muss hier kreativ werden, um aus der Fülle der Werkzeuge diejenigen auszuwählen und anzuwenden, die für seinen Einsatzzweck am wertvollsten sind.

So gibt es prinzipiell unterschiedliche Anforderungen für verschiedene Einsatzgebiete. Bei der Erstellung eines HD-DVD Masters wird nur einmal kodiert und zwar off-line bevor ein HDDVD Master erzeugt wird. Der kodierte Videostrom soll beste Qualität liefern und muss die HD-DVD Grenzwerte z.B. für die maximale Bitrate einhalten. Ein hochwertiger Software-Encoder wird das Rohmaterial in mehreren Durchläufen analysieren um etwa Szenenwechsel zu erkennen und dort zusätzliche I-Bilder einzufügen. Selbst wenn die Kodierung auf einem Hochleistungsrechner mehrere Tage dauert und manuelle Korrekturen erfordert, lohnt sich der Aufwand.

Ganz anders bei einer Netzwerkkamera zur Videoüberwachung. Hier ist eine preisgünstige Hardware- oder DSP-Lösung gefragt, die in Echtzeit einen kodierten Videostrom erzeugt und ihn netzwerkgerecht verpackt. B-Bilder sollten hier nicht eingesetzt werden, weil sie eine zusätzliche Verzögerung der Videodarstellung verursachen.

Wird ein Überwachungsvideo auf einer Festplatte aufgezeichnet, muss man sich eventuell allein auf I-Bilder einschränken, da hier vielleicht ein einziges Bild später als Beweismaterial oder Fahndungsfoto Verwendung findet. Auch bildgenaues Positionieren, Vorwärts- und Rückwärtsabspielen mit verschiedenen Geschwindigkeiten können wichtige Anwendungskriterien für eine „I-Bild only" Kodierung sein.

Die Kompressionsrate von H.264 sinkt dann zwar fast bis auf das Niveau von Motion-JPEG, trotzdem bietet der modernere H.264 Codec Features wie ein standardisiertes Dateiformat (ISO Media File Format), lippensynchrones Audio und Möglichkeiten zum Internet Streaming, die der ältliche Quasi-Standard Motion-JPEG nicht oder nur durch weitere proprietäre Erweiterungen bietet.

Profile und Level

Beginnend mit MPEG-1 werden bestimmte Gruppen von erlaubten Werkzeugen zu Profilen zusammengefasst. Verschiedenen maximale Bildgrößen, Bildraten und andere numerische Parameter werden zu Levels zusammengefasst. Das erlaubt es, verschiedene Ausprägungen eines Standards für verschiedene Märkte zu definieren und trotzdem eine Kompatibilität zu wahren.

Für einen Apple iPOD ist bspw. eine H.264 Fähigkeit von "Baseline Profil bis zu Level 1.3" spezifiziert. Das Baseline Profil untersagt unter anderem die Verwendung der effizienteren aber aufwändigeren kontextsensitiven arithmetischen Entropiekodierung (CABAC), Level 1.3 beschränkt die maximal erlaubte Bitrate auf 768 kBit/s, die Anzahl der Makroblöcke pro Bild auf 396 (352x288 Pixel, CIF Auflösung) und pro Sekunde auf 11880 (30 CIF Bilder pro Sekunde), was für das Display am Gerät auch angemessen ist.

Für die Dekodierung von Standard Fernsehbildern (Halbbildern) wird hingegen mindestens ein Level 3 Decoder benötigt, interlaced Video oder HDTV erfordern noch komplexere Profile wie Extended, Main oder High.

Ausblick

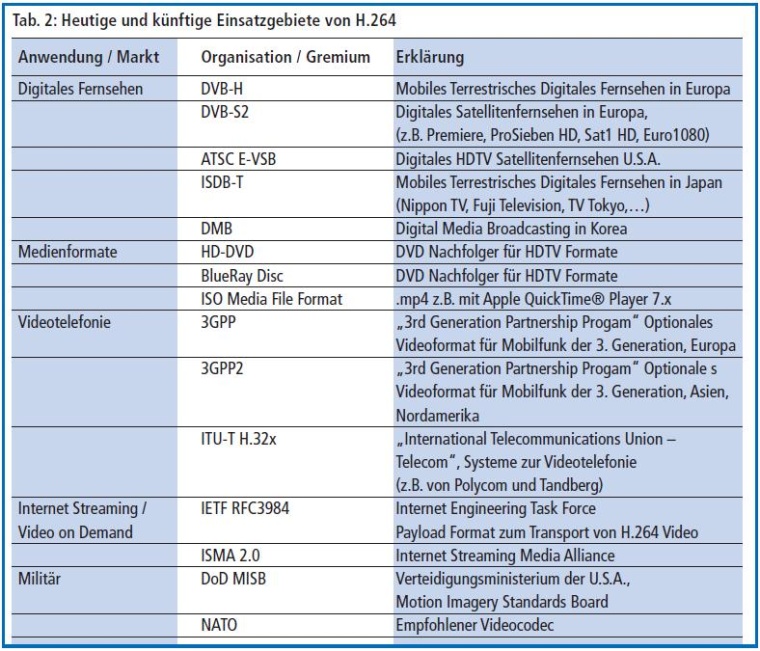

H.264 hat wohl das geschafft, was dem "alten" MPEG-4 versagt blieb: eine weitgehende Marktakzeptanz aufgrund der gegenüber dem etablierten MPEG-2 mit einem Faktor von 2 bis 3 deutlich besseren Kompression. Eine beeindruckende Menge von Medien-, Broadcastformaten und anderen Gremien nehmen H.264 Technologien in ihr Portfolio auf, siehe Tabelle 2. Mehr als 50 Hersteller haben bereits H.264 Hard- und Software Produkte im Angebot oder diese angekündigt.

Trotzdem werden die Forscher und Experten nicht müde und arbeiten bereits am nächsten Videostandard H.265, der bis 2008 vorgelegt werden soll. Selbst H.264 hat sich schon wieder verändert. Über einer AVC (Advanced Video Coding) kompatiblen Basisschicht können zusätzliche Videoschichten für verschiedene Klienten errichtet werden (SVC = Scalable Video Coding), etwa HDTV und SDTV in einem Videostrom oder sog. "Erosion Storages" für die Videoüberwachung: Videospeicher bei denen die Videos mit zunehmendem Lagerzeit ohne Neukodierung immer mehr ausgedünnt werden können, um wieder Speicherplatz für aktuelle Videodaten freizumachen.

Neben den technologischen Fortschritten sind für den Erfolg von Kodierungsverfahren auch immer mehr die Offenlegung der Spezifikation und klar definierte kalkulierbare Lizenzbedingungen von Bedeutung. Nicht zuletzt deshalb hat Microsoft eine Erweiterung ihres zunächst proprietär entwickelten Windows Media Codecs WMV-9 unter dem Namen VC-1 (SMPTE 421M) offengelegt. Und MPEG LA, eine Lizenzagentur die verschiedene Lizenzen für MPEG Technologien im Portfolio hat, hat im August 2006 angekündigt noch in 2006 Lizenzbedingungen für VC-1 zu benennen. Erst durch diese neue Offenheit hat Microsoft es geschafft, das ihr Verfahren nun gleichberechtigt neben MPEG-2 und H.264 auf den beiden potenziellen DVD Nachfolgemedien HD-DVD und Blu-Ray Disc unterstützt wird und somit neue Marktanteile gewinnen kann.

Literatur

B. Girod „Video Coding for Compression and Beyond," keynote speech, ICIP 2003, Barcelona, Spain, September 2003 H. Malvar, „Is there life after JPEG2000 and H.264?", Picture Coding Symposium 2004, University of California Davis, 15-17 December 2004 J. Ostermann u.a., „Video coding with H.264/AVC: Tools, Performance, and Complexity", IEEE Circuits and Systems Magazine, First Quarter 2004 K. Diepold: SMPTE VC-1 und MPEG-4 AVC im Vergleich. Digital Production, No. 4, p. 88-91, 2005 Apple iPOD Spezifikaion unter www.apple.com/de/ ipod/specs.html MPEG Homepage Leonard Chiariglione www.chiariglione. org

KONTAKT

Dr. Frank Bauernöppel

ZVEI-Fachverband Sicherheitssysteme, Frankfurt/M.

Tel.: 069/6302-0

Fax: 069/6302-288

zvei@zvei.org

www.zvei.org

Meist gelesen

Interview mit Klüh Security-Geschäftsführer Sven Horstmann über integrierte Alarmempfangsstelle (AES) und Notruf- und Serviceleitstelle (NSL)

Klüh Security: Zertifizierte AES/NSL setzt neue Maßstäbe für KRITIS-Schutz, Alarmmanagement und Informationssicherheit

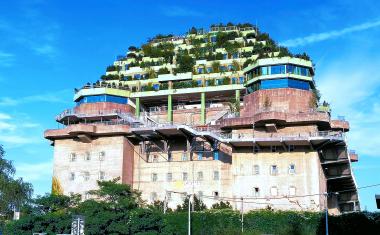

Grüner Bunker Hamburg: Intelligente Videoüberwachung und Personenzählung für ein sicheres, modernes Stadtgarten-Konzept“

Grüner Bunker Hamburg: Moderne Sicherheitstechnik, Besucherzählung und Videoüberwachung für einen einzigartigen Stadtgarten

BASF eröffnet 2028 innovatives Gefahrenabwehrzentrum in Ludwigshafen: KI-Technologie für maximale Sicherheit am Standort

BASF stärkt Sicherheit: Neues Gefahrenabwehrzentrum in Ludwigshafen mit KI & Leitstelle ab 2028

Wie digitale Fußvermessung und DGUV-konforme Einlagen Ausfallzeiten reduzieren – und Sicherheit im Betrieb stärken

Digitale Fußvermessung und Einlagenversorgung: Wie Unternehmen Ausfallzeiten senken und Mitarbeitende entlasten

Euchner mit IO-Link-Safety-Lösungen auf der Hannover Messe: Die letzten 20 Meter im Fokus

Auf der Hannover Messe präsentiert Euchner in Halle 27, Stand F50, seine neuesten Entwicklungen in der Sicherheitstechnik.